切换为使用验证码登录

而且造成“双盲”审稿机制泄露的BUG触发方式方式,简单到惊人:

你只需在浏览器中输入特定网址,并手动替换论文 ID 和审稿人编号,便能轻松查看任何审稿人的身份,甚至得知他们为你的论文打了多少分。没有任何操作门槛,这个漏洞一经传播,当晚所有人立马变成“侦探”,纷纷进入“调查模式”,仿佛一切恩怨都可以一一揭露。

毕竟,谁和审稿人没过几次“硬仗”呢?

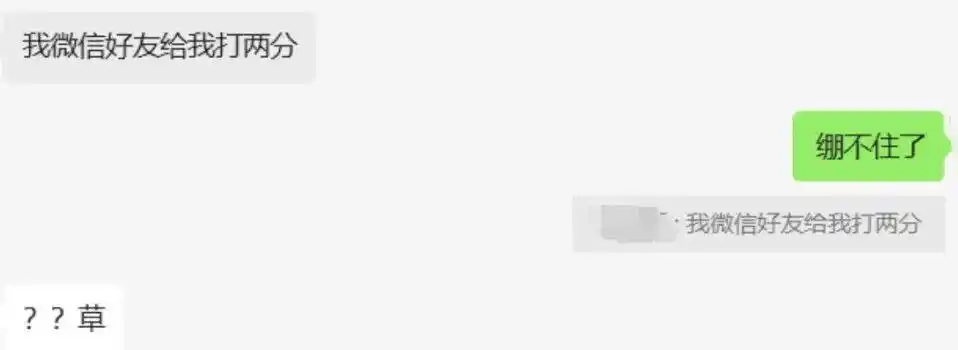

这次泄密不断在微信群、小红书等社交平台上传播扩散,受害者纷纷讲述自己的经历——有的是被低分的“冤屈”,也有的是因低分背后的“心机”事件,故事不计其数。

你永远猜不到,给你打低分的那个人会是谁。

背后的真相令人震惊

然后笔者通过各种渠道看下来,低分的原因五花八门。有的是由于审稿人未能理解作者的意图;有的则是出于个人恩怨(比如某些研究小组互相给低分);更有甚者,某些审稿人打低分,竟是为了给自己正在撰写的同赛道论文“让路”。一些受害者甚至通过这次泄露,证实了自己曾经被评了1分的论文,审稿人竟然在五个月后又提交了另一篇相关论文,且拒绝引用作者的投稿。

随着事件的发酵,更多爆料曝光。一些“恶意”打低分的审稿人,在身份曝光后紧急修正,提高了对论文的评分。社交媒体上的“吃瓜群众”感叹,这场审稿风暴,简直把长期积累的AI顶会审稿矛盾推到了高潮,drama迅速升级,简直从“黑暗森林”迈入了“广播纪元”。

匿名?网络永远不可靠!

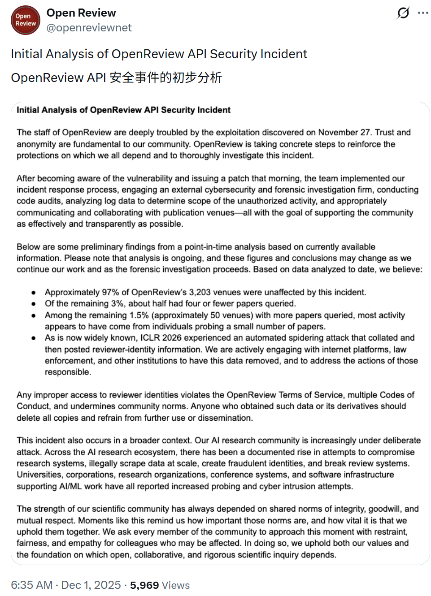

更令人震惊的是,更离谱的是,这漏洞还是系统级的 "硬伤"—— 只要稍微改改网址里的某些字符,不光能查今年 ICLR 的审稿信息,甚至连 NeurIPS、ICML、ACL 这些往年的评审数据都能扒出来,相当于把历年顶会的评审 "黑历史" 全翻了出来,这绝对能让所有评审们彻底抓狂。

审稿问题暴露背后问题

随着AI领域的火爆,投稿量暴增,审稿人不足的问题愈发突出,审稿质量不断下降。在ICLR 2026大会中,有数据显示,约21%的同行评审已经完全由人工智能生成,超过半数的评审带有AI痕迹。同时,部分论文的内容也完全是由AI生成,或有部分文本由AI辅助。这种现象显然引发了对学术公平和专业性的严重质疑。

然而,学术界的焦点不仅仅是AI在审稿中的“角色”,更重要的是如何应对这场审稿制度的危机,特别是匿名机制的暴露对公平性的影响。

泄露事件的后续及反思

作为 AI 领域的三大顶会之一,ICLR 近年来在学界、业界关注度持续提升,2026 的大会也即将在明年四月于巴西里约热内卢举行。本届大会获得了 19490 篇研究论文投稿,与此同时有 75800 篇同行评审意见。

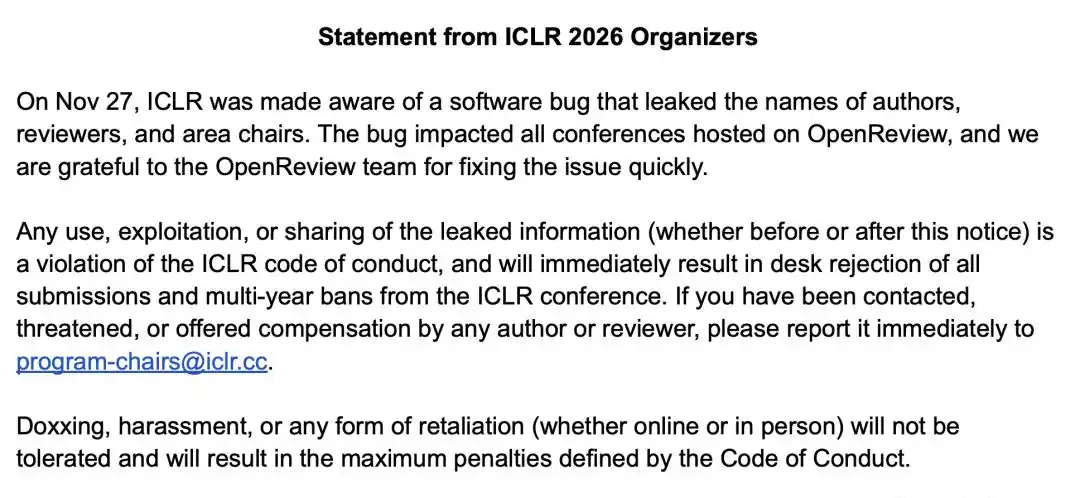

这个bug在大概周五零点被紧急修复,ICLR 终于发布了官方声明。

表示任何使用、暴露或分享泄露信息的人员将会被禁入ICLR,且未来可能采取进一步行动。虽然事件的处理已经开始。

不过这似乎并没有阻止部分人吃瓜的热情。似乎有人爬走了整份名单,还搞起了数据分析。有的人评选出了打分异常低的审稿人的名单。

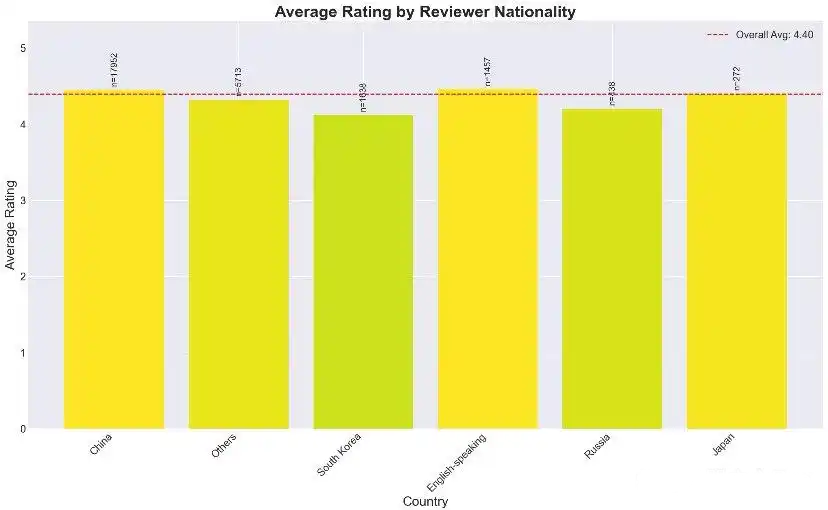

有人基于 ICLR 2026 前 1 万篇投稿的评审结果,结合审稿人的国别(主要语言)给出了平均打分习惯。看起来国人普遍比较慷慨,韩国人相对比较严格。

学界和业界的大佬们也纷纷参与到这场讨论中。加州理工学院的Yisong Yue教授在社交平台上直言:“赶紧开个紧急会议,我已经麻了!”

笔者就记得之前自己读研时有一个读博师兄投一本一区TOP刊,返修3次都2小修1拒稿,拒稿人的意见反馈明显有着挑刺和针对意味,他那段时间压力非常大,笔者写到这里不经想要是他要是知道这个漏洞,会不会也想去看看当年究竟是谁一直在拒自己的稿?

笔者自己也曾遇到过有篇文章曾莫名其妙被主编退稿,后来我发邮件质疑,主编才告诉我,原本是想退我前面那篇编号的文章,结果看错了……

你们也遇到过类似的事件吗?不妨在评论区里聊聊,看看到底有多奇葩的审稿人?

审稿人匿名制度面临新的挑战

总的来看,此次ICLR审稿内容泄露事件严重破坏了学术评价的公正性。

这次泄密事件无疑深刻影响了学术公平。审稿人匿名制度本是为了让评审更为客观、严谨,让评论者敢于说真话,不用担心得罪人。如今,审稿人身份曝光,可能导致作者求情、报复,甚至操控评审结果,原本的平衡已经被打破。这不可避免地影响了未来最终被接收论文的可信度与权威性。

然而另一方面,匿名制度也并非没有缺点。很多恶意、不负责任的审稿人曾借匿名之名,进行不公正的评分。此次泄露事件虽然引起了极大的关注,但也促使学术界重新思考:如何在确保公平的同时,维护评审的专业性和严肃性?

此次泄露或许在警示我们,学术评审需要在匿名性与责任性之间寻求更稳妥的平衡。